2018年是人工智能發展歷程中一個承前啟后的關鍵年份。這一年,人工智能基礎軟件開發呈現出前所未有的活力與創新,不僅在技術上實現了多項突破,還通過開源生態的繁榮與跨領域應用的深化,為后續AI技術的普及與演進奠定了堅實基礎。

一、技術框架的成熟與生態構建

2018年,TensorFlow、PyTorch等主流深度學習框架進一步鞏固了其市場地位。TensorFlow 2.0的預覽版本引入了Eager Execution模式,簡化了開發流程,增強了易用性;而PyTorch則憑借其動態計算圖的靈活性和直觀的編程接口,在學術界和工業界均獲得了廣泛青睞。開源社區的貢獻尤為突出,大量預訓練模型(如BERT、GPT-2的早期版本)和工具庫(如OpenAI的Gym、Facebook的Detectron)的發布,顯著降低了AI應用的開發門檻。這些框架不僅支持從研究到部署的全流程,還通過模塊化設計促進了模型的可復用性,使得開發者能夠更專注于創新而非底層實現。

二、算法創新與性能突破

在算法層面,2018年見證了生成對抗網絡(GANs)的多樣化和強化學習的實用化進展。BigGAN、StyleGAN等模型在圖像生成質量上取得了突破,展示了AI在創意領域的潛力;深度強化學習在游戲(如AlphaZero)、機器人控制等復雜任務中表現出色,推動了自主智能系統的發展。遷移學習和元學習成為研究熱點,它們通過利用已有知識或快速適應新任務,提升了AI在數據稀缺場景下的效能。這些算法的進步,不僅體現在學術論文中,更通過開源代碼的廣泛傳播,迅速轉化為實際工具,賦能各行各業。

三、硬件協同與優化加速

基礎軟件的開發離不開硬件支持。2018年,針對GPU、TPU等專用芯片的軟件優化工具日趨完善。NVIDIA的CUDA生態持續擴展,其深度學習加速庫(如cuDNN)為模型訓練提供了高效后端;而Google的TPU通過TensorFlow的緊密集成,為大規模機器學習任務帶來了性能提升。邊緣計算場景下,輕量級框架(如TensorFlow Lite、ONNX Runtime)開始興起,它們通過模型壓縮和量化技術,使AI應用能夠在移動設備和物聯網終端上高效運行。這種軟硬協同的創新,不僅加速了計算過程,還拓展了AI的部署邊界。

四、開發工具鏈的完善

為了提高開發效率,2018年AI基礎軟件工具鏈變得更加豐富。自動化機器學習(AutoML)工具如Google的Cloud AutoML和開源項目Auto-Keras嶄露頭角,它們通過自動化模型選擇和超參數調優,降低了機器學習的技術門檻。模型部署和管理平臺(如TensorFlow Serving、MLflow)也得到增強,支持從實驗到生產環境的無縫過渡。可視化調試工具(如TensorBoard)的功能擴展,幫助開發者更直觀地理解模型行為,加速了迭代過程。這些工具的出現,使得AI開發從“手工作坊”向“工業化流水線”演進。

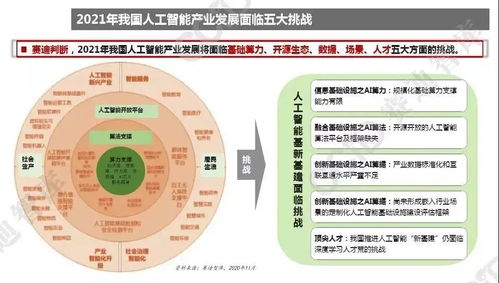

五、面臨的挑戰與未來趨勢

盡管成就顯著,2018年的AI基礎軟件開發也面臨挑戰:模型的可解釋性不足、數據隱私問題凸顯、算力需求日益增長等。開源協議的變化(如一些公司收緊許可)也引發了社區對技術開放性的擔憂。2018年的進展預示了多個趨勢:框架的融合與標準化(如ONNX格式的推廣)、邊緣AI軟件的爆發、以及倫理工具(如公平性檢測庫)的集成。這些方向將繼續推動AI基礎軟件向更高效、更普惠、更負責任的方向發展。

2018年,人工智能基礎軟件開發在技術創新與生態共建的雙輪驅動下,邁出了堅實步伐。它不僅為研究人員和工程師提供了強大工具,更通過開源精神促進了全球協作。這一年積累的經驗與成果,如同基石般支撐起后續AI浪潮的奔涌,提醒我們:在追逐性能突破的構建開放、可持續的軟件生態,才是賦能未來的關鍵所在。